而在对AI进行训练测试后,发现成绩依然不理想。

数据集中的分步解决方案,能让语言模型像人类数学家一样使用 “短期记忆”。

即模型不必马上得出正确答案,而是可以逐步探索解法一步步走向正确答案。

但即使有了解决方案,研究者发现,对于GPT-2和GPT-3来说,准确率仍然很低.

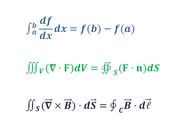

从上图结果中能看出,让模型在产生答案之前生成自己的解决方案,实际上降低了准确性。因为在许多错误案例中,尽管解题步骤与问题相关,但它们是不合逻辑的。

此外,简单地增加模型中的训练时间和参数数量,有时会提高性能。但事实证明,这样做的代价过于高,训练的时间和能耗都大大增加。

而在AMPS上进行预训练可将准确率提升约25%,这相当于将模型大小提高15倍。

所以,尽管恶补了12500道高中数学竞赛题,GPT-3还是不及格。

但研究人员认为,让AI学会分步解题仍然有进步意义。

与直接在问题和答案上进行训练相比,MATH上训练过的模型,可以提高10%的相对准确率。

最重要的,是模型“掌握”了一些基本数学知识。在一些错误的解法下,AI已经懂得调用相关的公式定理,而不是胡言乱语一通。

AI数学竞赛的第一课,并不是毫无收获。

GPT-3也不要灰心,伯克利的团队说了,随着对模型的改进,今后它们的数学推理能力会越来越强。

MATH和AMPS现在都已开源,有兴趣的研究者可以直接下载:

https://github.com/hendrycks/math/

,