图 3. 2D /三维 P-Net 与 CRF 网的 CNN 结构(f)。卷积层的参数是(内核大小、输出通道、膨胀)在深蓝色矩形中。块 1 到块 6 保持分辨率。2D/3D R-Net 使用与 2D/3D P-Net 相同的结构,只是其输入有三个附加通道,如图 2 所示,CRF 网络(f)由 CRF 网络(fu)代替。

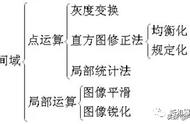

2.3具有自由形式成对势和用户约束的后向可传播 CRF 网

从参考文献中我们发现了一种基于 RNN 的 CRF 算法,它可以通过反向传播进行训练。我们没有使用高斯函数,而是扩展了这个 CRF,使得成对势可以是自由形式的函数,我们称之为 CRF 网(f)。此外,我们将用户交互集成到 CRF-Net(f)中的交互式优化上下文中,称为 CRF-Net(fu)。CRF 网(f)与 P-Net 相连,CRF 网(fu)与 R 网相连。

图 4.成对势函数的成对网

2.4实施细则

光栅扫描算法用于计算测地距离变换,方法是使用 3×3 的内核用于 2D 和一个 3×3×3 的 3D 内核。假设一个大小为 M×N 的图像、完全连接的 CRF 具有 MN(MN-1)像素对。对于 M=N=100 的小图像,像素对的数目几乎是 108 个,这不仅需要大量的内存,而且需要很长的计算时间。第二,尽管长距离相关性有助于改善大多数 RGB 图像的分割,但这对于医学图像来说是非常具有挑战性的,因为目标和背景之间的对比度通常很低。在这种情况下,长距离依赖可能导致目标像素的标签被具有相似外观的大量背景像素破坏。因此,为了保持良好的效率和避免长距离的损坏,我们定义了一个像素在一个局部补丁中心的成对连接。在我们的实验中,补丁大小设置为 7×7 的用于 2D 图像、5×5×3 的 3D 图像。

在用 CRF-Net(f)训练 P-Net 之后,我们自动模拟用户交互,用 CRF-Net(fu)训练 R-Net。首先,利用 P-Net 和 CRF-Net(f)对训练图像进行自动分割。将其与地面真值进行比较,找出误分割区域。然后,在每个分割错误的区域中随机抽取 n 个像素,模拟用户之间的交互。通过训练数据初始分割上的这些模拟用户交互,通过 SGD 实现了用 CRF-Net(fu)训练 R-Net,这类似于用 CRF-Net(f)训练 P-Net。

图 5.胎盘(a)和脑肿瘤(b,c)训练图像上的模拟用户交互。绿色:由 P-Net 和 CRF-Net(f)给出的自动分割。黄色:地面真相。红色(青色):模拟点击下分割(过度分割)。

3.实验

3.1比较方法和评价指标

我们首先给出了在第一阶段得到的结果,然后给出了在第二阶段得到的结果。

第一阶段,我们比较了 P-Net 与 FCN 和 Deep-Lab 的 2D 分割,以及 DeepMedic 和 HighRes3DNet 的 3D 分割。我们还比较了 2D/3D P-Net 和 2D/3D P-Net(b5),2D/3D P-Net 只使用块 5(图 3)的特征,而不是级联的多尺度特征。将提出的具有自由形式成对势的 CRF 网(f)与已有的 CRF 网(f)进行了比较:1). 密集 CRF 作为 P-Net 输出的独立后处理步骤。2).CRF-Net(g)是指可以利用高斯成对势与 CNNs 联合训练的 CRF。

对于第二阶段,即交互细化部分,我们比较了三种处理用户交互的方法。1). Min-cut 用户编辑,其中初始概率图与用户交互相结合,用 Min-cut 解决能量最小化问题;2). 使用 R-Net 中用户交互的欧氏距离,称为 R-Net,3)。提出了一种具有用户交互测地距离的 R 网。

为了定量评估,我们测量了 Dise 得分和平均对称表面距离(ASSD)。

其中 Ra 和 Rb 分别表示由算法分割的区域和地面真值。