k_i=sqrt{dfrac{lambda_m}{lambda_i}},i=0,1,2,cdots,p

为特征根lambda_{i}的条件数。矩阵X’X的特征根的离散程度用条件数来度量,可以判断多重共线性的存在以及严重程度,如果0<k<10时,设计矩阵X多重共线性不存在,10≤k<100时,多重共线性情况比较严重,当k≥100,共线性非常严重。

那么如果存在多重共线性应该如何解决呢?

三、解决办法

如果存在多重共线性问题,一般可以从三个方面进行说明,剔除变量、增大样本量以及更换模型。

1.剔除变量

剔除变量是处理共线性最直接的办法。一般可以找出引起多重共线性的解释变量,然后把它从模型中剔除,但是常常不容易判断具体哪一个变量引起的多重共线性,所以一般解决办法有逐步回归法等。逐步回归是在模型中逐个引入解释变量,如果新引入的变量使得模型统计意义检验或者判断与事实相符,并且R方又能提高,则应该引入,反之无需引入。但是,排除引起共线性的变量后,保留在模型中变量的系数估计值将会改变,并且实际意义也会发生变化。

2.增大样本量

一般如果在计量经济模型中,入股变量的样本数据极少,很容易引起多重共线性问题,可以通过手机更多的观测值来增加样本量,可以避免或者减少共线性的影响,但是会引起计算量的增加。

3.更换模型

除此之外,还可以更换研究模型,利用岭回归、主成分回归、Lasso回归等。

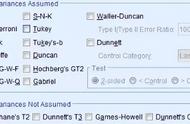

岭回归是以引入偏误来减少参数估计量方差的方法,虽然通过岭回归能使数据变的更合理,但是如果是原模型的实际意义不合理,即使通过岭回归修正后也不一定使模型通过实际意义的检验,所以说在实际应用中也不是所有的共线性都可以用岭回归来解决。操作如下:

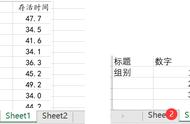

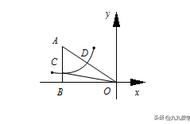

主成分回归中主成分分析又称主分量分析,他是利用降维的思想,在尽量减少损失的信息的前提下,把多个指标通过正交旋转转化为几个综合的指标的分析方法,其基本原理是:利用主成分分析将解释变量转换成若干个主成分,这些主成分从不同侧面反映了解释变量的综合影响,然后在讲解释变量对这些主成分进行回归,在根绝主成分分与解释变量之间的关系,求得原回归模型的估计方程。比如有6个X,其利用降维原理将6个X降维成比如2个主成分,然后后续再进行分析比如线性回归(此种做法称作主成分回归)。操作如下:

Lasso回归

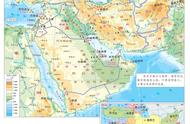

Lasso回归分析(Lasso Regression)是一种用于解决线性回归分析中自变量共线性的研究算法。针对Lasso回归:其研究步骤共为2步,分别是结合轨迹图寻找最佳K值;输入K值进行回归建模。具体如下:

第一步:Lasso回归分析前需要结合轨迹图确认K值;K值的选择原则是各个自变量的标准化回归系数趋于稳定时的最小K值。K值越小则偏差越小,K值为0时则为普通线性OLS回归;SPSSAU提供K值智能建议,也可通过主观识别判断选择K值;

第二步:对于K值,其越小越好,通常建议小于1,确定好K值后,得出Lasso回归模型估计。操作如下: